Deepfake là gì?

Deepfake (một từ ghép của “deep learning” và “fake”) là một kỹ thuật để tổng hợp hình ảnh con người dựa trên trí tuệ nhân tạo (AI). Nó được sử dụng để kết hợp và chồng các hình ảnh và video hiện có lên các hình ảnh hoặc video nguồn bằng cách sử dụng một kỹ thuật học máy (machine learning) được gọi là Generative Adversarial Network (tạm dịch là mạng chống đối tạo sinh). Cụm từ Deepfake đã được đặt ra vào năm 2017.

Nói nôm na, dễ hiểu thì deepfake là những nội dung giả được tạo ra từ AI, có thể là hình ảnh, video, thậm chí là âm thanh mà rất khó phân biệt thật giả bằng mắt/tai theo cách thông thường.

Vì những khả năng này, deepfake được sử dụng để tạo tin tức giả và những trò lừa đảo độc hại.

=>> Có thể bạn quan tâm: Top 1 cổng game đổi thưởng uy tín nhất Việt Nam – Tải Iwin68 nhận tiền thật mỗi ngày

Video deepfake được tạo ra bằng cách nào?

Video deepfake được tạo sử dụng hai hệ thống AI, một hệ thống được gọi là generator (bộ tạo) và hệ thống còn lại gọi là discriminator (bộ phân biệt). Generator tạo một clip video giả và sau đó yêu cầu discriminator xác nhận xem đâu là clip giả, đâu là clip thật. Mỗi lần discriminator phân biệt chính xác một video clip giả, nó sẽ cung cấp cho generator một manh mối về những việc không nên làm khi tạo clip tiếp theo.

Generator và discriminator tạo một thứ được gọi là Generative Adversarial Network (GAN). Bước đầu tiên là thiết lập một mạng GAN để xác định đầu ra mong muốn và tạo cơ sở dữ liệu đào tạo cho generator. Khi generator bắt đầu tạo mức đầu ra chấp nhận được, video clip có thể được cấp cho discriminator.

Generator và discriminator liên tục cải thiện khả năng trong quá trình tạo video deepfake. Khi generator làm tốt hơn trong việc tạo video clip giả, discriminator cũng tăng khả năng phát hiện ra chúng. Ngược lại, khi discriminator phát hiện video giả tốt hơn, generator cũng tạo video giả ngày một tinh vi.

Cho đến gần đây, nội dung video đã khó thay đổi hơn. Tuy nhiên, vì deepfake được tạo thông qua AI, nên chúng không yêu cầu kỹ năng đáng kể để tạo một video thực tế. Thật không may, điều này có nghĩa là bất cứ ai cũng có thể tạo ra một deepfake. Một điều nguy hiểm nữa là mọi người sẽ không tin tưởng vào tính hợp lệ của bất cứ nội dung video nào nữa.

Tìm hiểu thêm: Iwin – game bài đổi thưởng

Deepfake được sử dụng như thế nào?

Mặc dù khả năng tự động hoán đổi khuôn mặt để tạo video tổng hợp trông chân thực và đáng tin cậy có một số ứng dụng thú vị và không gây hại (chẳng hạn như trong phim ảnh và khi chơi game), đây rõ ràng là một công nghệ nguy hiểm và có thể gây rắc rối. Trên thực tế, một trong những ứng dụng thực tế đầu tiên cho deepfake là để tạo ra nội dung khiêu dâm, gây tổn hại nghiêm trọng đến danh tiếng của người khác. Theo báo cáo của Deeptrace, nội dung khiêu dâm chiếm 96% các video deepfake được tìm thấy trực tuyến vào năm 2019.

Video Deepfake cũng đã được sử dụng trong chính trị. Ví dụ, vào năm 2018, một đảng chính trị của Bỉ đã phát hành video ông Donald Trump có bài phát biểu kêu gọi Bỉ rút khỏi thỏa thuận khí hậu Paris. Tuy nhiên, ông Trump chưa bao giờ đưa ra bài phát biểu đó – đó là một deepfake.

Đây không phải là lần đầu tiên deepfake được sử dụng để tạo video gây hiểu lầm và các chuyên gia chính trị am hiểu về công nghệ đang chuẩn bị cho làn sóng tin tức giả trong tương lai có những deepfake thực tế một cách thuyết phục.

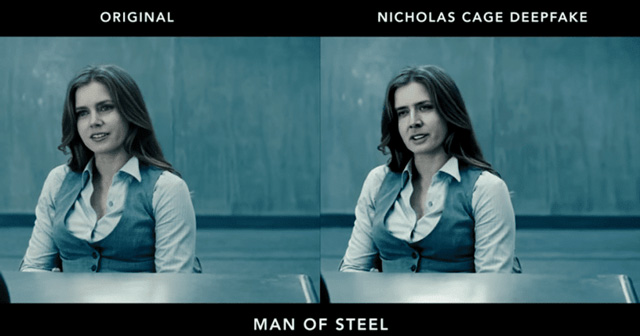

Tất nhiên, không phải tất cả video deepfake đều gây ra mối đe dọa hiện hữu đối với nền dân chủ. Không thiếu những câu chuyện sâu sắc được sử dụng với mục đích hài hước và châm biếm, chẳng hạn như những con chip sẽ trả lời câu hỏi: Nicolas Cage sẽ trông như thế nào nếu anh ấy xuất hiện trong “Raiders of the Lost Ark”?

Có phải deepfake chỉ bao gồm video không?

Deepfake không chỉ giới hạn ở video. Deepfake audio là một lĩnh vực đang phát triển nhanh chóng, với số lượng ứng dụng khổng lồ.

Giờ đây, có thể tạo ra âm thanh giả mạo nghe rất chân thực bằng cách sử dụng các thuật toán deep learning chỉ với vài giờ (hoặc trong một số trường hợp, vài phút) bằng file âm thanh của người có giọng nói đang được sao chép. Sau khi tạo ra một mẫu giọng nói, có thể tạo ra âm thanh người đó đang nói bất cứ điều gì, chẳng hạn như bản ghi giả mạo giọng nói của một giám đốc điều hành được sử dụng để lừa đảo vào năm ngoái.

Deepfake audio có các ứng dụng y tế dưới dạng thay thế giọng nói, cũng như trong thiết kế game trên máy tính. Giờ đây các nhà lập trình có thể cho phép các nhân vật trong game nói bất cứ điều gì trong thời gian thực, thay vì dựa vào một bộ script giới hạn đã được ghi lại trước trong game.

Làm thế nào để phát hiện một deepfake?

Khi deepfake trở nên phổ biến hơn, xã hội nói chung rất có thể sẽ cần phải thích ứng với việc phát hiện các video deepfake, giống như cách người dùng trực tuyến hiện đang chú ý đến việc phát hiện những loại tin giả khác.

Thông thường, cũng như trường hợp an ninh mạng, công nghệ deepfake phải xuất hiện nhiều hơn để mọi người có thể phát hiện và ngăn chặn nó lây lan, nhưng từ đó có thể tạo ra một vòng luẩn quẩn và rất có khả năng tạo ra nhiều tác hại hơn.

Có một số dấu hiệu để chỉ ra một deepfake là:

– Deepfake hiện tại gặp khó khăn trong việc tạo hoạt ảnh khuôn mặt một cách chân thực và kết quả là một video mà trong đó đối tượng không bao giờ chớp mắt quá thường xuyên hoặc không tự nhiên. Tuy nhiên, sau khi các nhà nghiên cứu tại Đại học Albany công bố một nghiên cứu phát hiện ra sự bất thường trong việc nháy mắt, các deepfake mới phát hành không còn vấn đề này nữa.

– Có những vấn đề về da hoặc tóc hoặc khuôn mặt có vẻ mờ hơn so với môi trường. Tiêu điểm có thể trông không tự nhiên.

– Ánh sáng trông không tự nhiên? Thông thường, các thuật toán deepfake sẽ giữ lại ánh sáng của những clip được sử dụng làm mô hình cho video giả mạo, điều này không phù hợp với ánh sáng trong video đích.

– Âm thanh có thể không khớp với người, đặc biệt nếu video bị làm giả nhưng âm thanh gốc không được xử lý cẩn thận.

Đấu tranh với deepfake bằng công nghệ

Mặc dù deepfake sẽ chỉ thực tế hơn theo thời gian khi các kỹ thuật được cải thiện, nhưng không phải là không có các biện pháp chống lại chúng. Một số công ty đang phát triển các phương pháp để phát hiện ra deepfake, trong số đó có các công ty khởi nghiệp.

Ví dụ, Sensity đã phát triển một nền tảng phát hiện tương tự như một phần mềm diệt virus để cảnh báo người dùng qua email khi họ đang xem thứ gì đó có dấu hiệu do AI tạo ra. Sensity sử dụng các tiến trình deep learning giống nhau được dùng để tạo video giả.

Operation Minerva thực hiện một cách tiếp cận đơn giản hơn để phát hiện các deepfake. Thuật toán của công ty này so sánh các deepfake tiềm năng với những video đã biết, được “lấy dấu vân tay kỹ thuật số”. Chẳng hạn, nó có thể phát hiện các ví dụ về những đoạn phim khiêu dâm, bằng cách nhận ra rằng video deepfake chỉ là phiên bản sửa đổi của video hiện có mà Operation Minerva đã lập danh mục.

Và năm ngoái, Facebook đã tổ chức Deepfake Detection Challenge, một sáng kiến hợp tác cởi mở, nhằm khuyến khích việc tạo ra các công nghệ mới để phát hiện deepfake và những loại nội dung media bị thao túng khác. Cuộc thi có giải thưởng lên đến $500.000.